MACHINES À CALCULER ET INTELLIGENCE

par

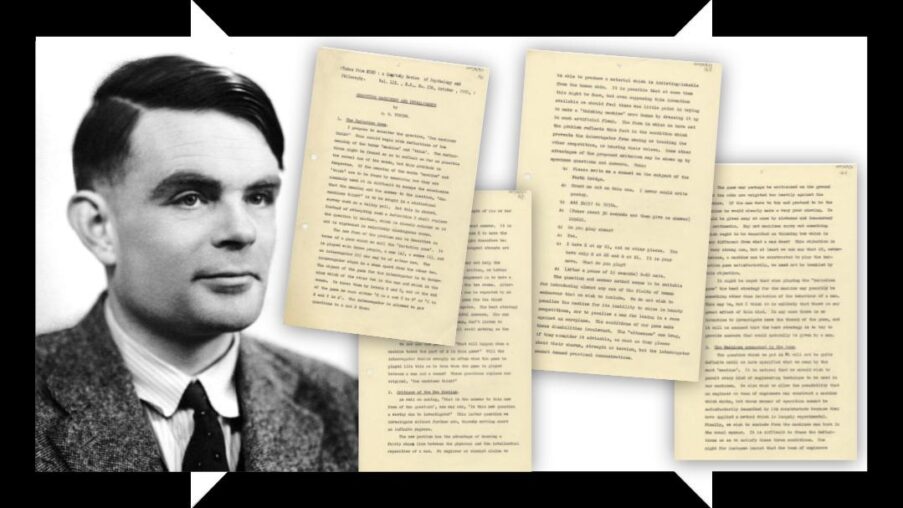

A. M. TURING

1. Le Jeu de l’Imitation

Je propose de considérer la question, « Les machines peuvent-elles penser ? » Cela devrait commencer par des définitions du sens des termes « machine » et « penser ». Ces définitions pourraient être formulées de manière à refléter autant que possible l’usage normal des mots, mais cette attitude est dangereuse. Si le sens des mots « machine » et « penser » doit être trouvé en examinant la manière dont ils sont communément employés il est difficile d’échapper à la conclusion que le sens et la réponse à la question, « Les machines peuvent-elles penser ? » doivent être recherchés dans une enquête statistique telle qu’un sondage Gallup. Mais cela est absurde. Au lieu de tenter une telle définition je remplacerai la question par une autre, qui lui est étroitement liée et qui est formulée en des mots relativement non ambigus.

Cette nouvelle forme du problème peut être décrite en termes d’un jeu que nous appellerons le « jeu de l’imitation ». Il se joue avec trois personnes, un homme (A), une femme (B), et un interrogateur (C), qui pourrait être de l’un ou l’autre sexe. L’interrogateur reste dans une pièce séparée des deux autres. Le but du jeu pour l’interrogateur est de déterminer lequel des deux autres est l’homme et laquelle est la femme. Il les connaît sous les étiquettes X et Y, et à la fin du jeu il dit soit « X est A et Y est B » soit « X est B et Y est A ». L’interrogateur est autorisé à poser des questions à A et B ainsi :

C : X voudrait-il ou voudrait-elle bien me dire la longueur de ses cheveux ?

Supposons maintenant que X soit en réalité A, alors A doit répondre. Le but de A dans le jeu est d’essayer d’amener C à faire la mauvaise identification. Sa réponse pourrait donc être

« Mes cheveux sont coupés à la garçonne, et les mèches les plus longues mesurent environ neuf pouces. »

Afin que le timbre de la voix ne puisse pas aider l’interrogateur les réponses devraient être écrites, ou mieux encore, dactylographiées. Le dispositif idéal serait d’avoir un téléimprimeur assurant la communication entre les deux pièces. Alternativement la question et les réponses peuvent être répétées par un intermédiaire. Le but du jeu pour la troisième joueuse (B) est d’aider l’interrogateur. La meilleure stratégie pour elle consiste probablement à donner des réponses véridiques. Elle peut ajouter des choses comme « Je suis la femme, ne l’écoutez pas ! » à ses réponses, mais cela ne lui servira à rien puisque l’homme peut faire des remarques similaires.

Nous posons maintenant la question, « Que se passera-t-il lorsqu’une machine prendra la place de A dans ce jeu ? » L’interrogateur fera-t-il la mauvaise identification aussi souvent lorsque le jeu se joue ainsi que lorsqu’il se joue entre un homme et une femme ? Ces questions remplacent notre question initiale, « Les machines peuvent-elles penser ? »

2. Critique du Nouveau Problème

En plus de se demander, « Quelle est la réponse à cette nouvelle forme de la question », on peut se demander, « Cette nouvelle question vaut-elle la peine d’être étudiée ? » Cette dernière question nous l’étudierons sans plus tarder, coupant court par là à une régression à l’infini.

Le nouveau problème a l’avantage de tracer une ligne assez nette entre les capacités physiques et les capacités intellectuelles d’un homme. Aucun ingénieur ni chimiste ne prétend être capable de produire un matériau qui soit indistinguable de la peau humaine. Il est possible qu’un jour cela puisse être fait, mais même en supposant cette invention disponible nous estimerions qu’il y aurait peu d’intérêt à essayer de rendre une « machine pensante » plus humaine en l’habillant d’une telle chair artificielle. La forme dans laquelle nous avons posé le problème reflète ce fait dans la condition qui empêche l’interrogateur de voir ou de toucher les autres concurrents, ou d’entendre leurs voix. Quelques autres avantages du critère proposé peuvent être montrés par des exemples de questions et de réponses. Ainsi :

Q : Veuillez me composer un sonnet sur le pont du Forth.

R : Ne comptez pas sur moi pour celui-là. Je n’ai jamais su écrire de poésie.

Q : Additionnez 34957 et 70764.

R : (Pause d’environ 30 secondes, puis réponse) 105621.

Q : Jouez-vous aux échecs ?

R : Oui.

Q : J’ai K à mon K1, et aucune autre pièce. Vous n’avez que K à K6 et R à R1. C’est à vous de jouer. Que jouez-vous ?

R : (Après une pause de 15 secondes) R-R8 mat.

La méthode des questions et réponses semble convenir pour introduire presque n’importe lequel des domaines de l’activité humaine que nous souhaitons inclure. Nous ne souhaitons pas pénaliser la machine pour son inaptitude à briller dans des concours de beauté, ni pénaliser un homme pour perdre dans une course contre un aéroplane. Les conditions de notre jeu rendent ces incapacités sans pertinence. Les « témoins » peuvent, s’ils le jugent opportun, se vanter autant qu’il leur plaît de leurs charmes, de leur force ou de leur héroïsme, mais l’interrogateur ne peut exiger de démonstrations pratiques.

Le jeu pourrait être critiqué au motif que les chances pèsent trop lourdement contre la machine. Si l’homme essayait de se faire passer pour la machine il ferait manifestement très piètre figure. Il serait trahi aussitôt par sa lenteur et son inexactitude en arithmétique. Les machines ne peuvent-elles pas accomplir quelque chose qui devrait être décrit comme le fait de penser mais qui est très différent de ce que fait un homme ? Cette objection est très forte, mais du moins pouvons-nous dire que si, néanmoins, une machine peut être construite pour jouer le jeu de l’imitation de manière satisfaisante, nous n’avons pas à nous laisser troubler par cette objection.

On pourrait soutenir que, lorsqu’elle joue au « jeu de l’imitation », la meilleure stratégie pour la machine peut éventuellement être autre chose que l’imitation du comportement d’un homme. Cela se peut, mais je pense qu’il est peu probable qu’il y ait un grand effet de ce genre. Quoi qu’il en soit il n’y a ici aucune intention d’examiner la théorie du jeu, et il sera supposé que la meilleure stratégie est d’essayer de fournir des réponses qui seraient naturellement données par un homme.

3. Les Machines Concernées par le Jeu

La question que nous avons posée au § 1 ne sera pas tout à fait définie tant que nous n’aurons pas précisé ce que nous entendons par le mot « machine ». Il est naturel que nous souhaitions permettre que toute espèce de technique d’ingénierie soit utilisée dans nos machines. Nous souhaitons aussi admettre la possibilité qu’un ingénieur ou une équipe d’ingénieurs puisse construire une machine qui fonctionne, mais dont la manière d’opérer ne puisse être décrite de façon satisfaisante par ses constructeurs parce qu’ils ont appliqué une méthode largement expérimentale. Enfin, nous souhaitons exclure des machines les hommes nés de la manière habituelle. Il est difficile de formuler les définitions de façon à satisfaire ces trois conditions. On pourrait par exemple insister pour que l’équipe d’ingénieurs fût tout entière d’un seul sexe, mais cela ne serait pas vraiment satisfaisant, car il est probablement possible d’élever un individu complet à partir d’une cellule unique de la peau (disons) d’un homme. Ce serait là un exploit de technique biologique méritant les plus grands éloges, mais nous ne serions pas enclins à le considérer comme un cas de « construction d’une machine pensante ». Cela nous invite à abandonner l’exigence selon laquelle toute espèce de technique devrait être permise. Nous sommes d’autant plus prêts à le faire que l’intérêt actuel pour les « machines pensantes » a été suscité par un type particulier de machine, ordinairement appelé « calculateur électronique » ou « calculateur numérique ». Suivant cette suggestion nous ne permettons qu’aux calculateurs numériques de prendre part à notre jeu.

Cette restriction paraît à première vue très drastique. Je tenterai de montrer qu’il n’en est pas ainsi en réalité. Pour ce faire il est nécessaire de donner un bref exposé de la nature et des propriétés de ces calculateurs.

On peut aussi dire que cette identification des machines aux calculateurs numériques, comme notre critère pour « penser », ne sera insatisfaisante que si (contrairement à ma croyance), il s’avère que les calculateurs numériques sont incapables de faire bonne figure dans le jeu.

Il existe déjà un certain nombre de calculateurs numériques en état de marche, et l’on peut demander : « Pourquoi ne pas tenter l’expérience tout de suite ? Il serait facile de satisfaire aux conditions du jeu. Un certain nombre d’interrogateurs pourraient être employés, et des statistiques pourraient être compilées pour montrer la fréquence avec laquelle la bonne identification serait donnée. » La réponse courte est que nous ne demandons pas si tous les calculateurs numériques figureraient bien dans le jeu ni même si les calculateurs actuellement disponibles y figureraient bien, mais s’il existe des calculateurs imaginables qui y figureraient bien. Mais ce n’est là que la réponse courte. Nous verrons cette question sous un autre jour plus loin.

4. Calculateurs Numériques

L’idée qui se trouve derrière les calculateurs numériques peut être expliquée en disant que ces machines sont destinées à exécuter toutes opérations qui pourraient être exécutées par un calculateur humain. Le calculateur humain est supposé suivre des règles fixes ; il n’a aucune autorité pour s’en écarter dans le moindre détail. Nous pouvons supposer que ces règles lui sont fournies dans un livre, qui est modifié chaque fois qu’il est affecté à un nouveau travail. Il dispose aussi d’une réserve illimitée de papier sur lequel il effectue ses calculs. Il peut aussi faire ses multiplications et ses additions sur une « machine de bureau », mais cela n’a pas d’importance.

Si nous utilisons l’explication ci-dessus comme définition nous courrons le danger de la circularité de l’argument. Nous évitons cela en donnant une esquisse des moyens par lesquels l’effet désiré est obtenu. Un calculateur numérique peut d’ordinaire être regardé comme consistant en trois parties :

- Stockage.

- Unité exécutive.

- Contrôle.

Le stockage est le stockage de l’information, et correspond au papier du calculateur humain, que ce soit le papier sur lequel il effectue ses calculs ou celui sur lequel son livre de règles est imprimé. Dans la mesure où le calculateur humain effectue des calculs de tête une partie du stockage correspondra à sa mémoire.

L’unité exécutive est la partie qui effectue les diverses opérations individuelles impliquées dans un calcul. Ce que sont ces opérations individuelles variera d’une machine à l’autre. D’ordinaire des opérations assez longues peuvent être effectuées telles que « Multipliez 3540675445 par 7076345687 » mais dans certaines machines seules des opérations très simples telles que « Écrivez 0 » sont possibles.

Nous avons mentionné que le « livre de règles » fourni au calculateur est remplacé dans la machine par une partie du stockage. On l’appelle alors la « table d’instructions ». Il est du devoir du contrôle de veiller à ce que l’on obéisse correctement à ces instructions et dans le bon ordre. Le contrôle est construit de telle manière que cela arrive nécessairement.

L’information dans le stockage est d’ordinaire divisée en paquets de taille modérément petite. Dans une machine, par exemple, un paquet pourrait consister en dix chiffres décimaux. Des nombres sont attribués aux parties du stockage dans lesquelles sont stockés les divers paquets d’information, d’une manière systématique. Une instruction typique pourrait dire —

« Ajoutez le nombre stocké en position 6809 à celui qui se trouve en 4302 et remettez le résultat dans cette dernière position de stockage ».

Il va sans dire qu’elle n’apparaîtrait pas dans la machine exprimée en français. Elle serait plus probablement codée sous une forme telle que 6809430217. Ici 17 indique laquelle, parmi les diverses opérations possibles, doit être effectuée sur les deux nombres. Dans ce cas l’opération est celle décrite ci-dessus, à savoir « Ajoutez le nombre… ». On remarquera que l’instruction occupe 10 chiffres et forme ainsi un paquet d’information, très commodément. Le contrôle prendra normalement les instructions auxquelles il faut obéir dans l’ordre des positions dans lesquelles elles sont stockées, mais il pourra arriver qu’une instruction telle que

« Obéissez maintenant à l’instruction stockée en position 5606, et continuez à partir de là »

soit rencontrée, ou encore

« Si la position 4505 contient 0 obéissez ensuite à l’instruction stockée en 6707, autrement continuez tout droit. »

Les instructions de ces derniers types sont très importantes parce qu’elles rendent possible qu’une suite d’opérations soit répétée encore et encore jusqu’à ce qu’une certaine condition soit remplie, mais qu’en le faisant elle obéisse, non à de nouvelles instructions à chaque répétition, mais aux mêmes, encore et encore. Prenons une analogie domestique. Supposons que Maman veuille que Tommy passe chez le cordonnier tous les matins sur le chemin de l’école pour voir si ses souliers sont prêts, elle peut le lui demander à nouveau chaque matin. Alternativement elle peut afficher une fois pour toutes un avis dans l’entrée qu’il verra en partant pour l’école et qui lui dit de passer prendre les souliers, et aussi de détruire l’avis lorsqu’il revient s’il a les souliers avec lui.

Le lecteur doit accepter comme un fait que des calculateurs numériques peuvent être construits, et l’ont en effet été, selon les principes que nous avons décrits, et qu’ils peuvent effectivement reproduire de très près les actions d’un calculateur humain.

Le livre de règles que nous avons décrit notre calculateur humain comme utilisant est bien entendu une fiction commode. Les calculateurs humains réels se souviennent réellement de ce qu’ils ont à faire. Si l’on veut faire qu’une machine reproduise le comportement du calculateur humain dans quelque opération complexe, il faut lui demander comment elle s’effectue, puis traduire la réponse sous la forme d’une table d’instructions. La construction de tables d’instructions est habituellement décrite comme la « programmation ». « Programmer une machine pour effectuer l’opération A » signifie introduire dans la machine la table d’instructions appropriée afin qu’elle fasse A.

Une variante intéressante sur l’idée du calculateur numérique est un « calculateur numérique comportant un élément aléatoire ». Ceux-ci possèdent des instructions impliquant le jet d’un dé ou quelque processus électronique équivalent ; une telle instruction pourrait par exemple être : « Jetez le dé et placez le nombre résultant dans le stockage 1000 ». On décrit parfois une telle machine comme ayant un libre arbitre (bien que je n’emploierais pas moi-même cette expression). Il n’est pas normalement possible de déterminer, en observant une machine, si elle comporte un élément aléatoire, car un effet semblable peut être produit par des dispositifs tels que le fait de faire dépendre les choix des chiffres du développement décimal de π.

La plupart des calculateurs numériques effectifs n’ont qu’un stockage fini. Il n’y a pas de difficulté théorique dans l’idée d’un calculateur doté d’un stockage illimité. Bien entendu seule une partie finie peut en avoir été utilisée à un moment donné. De même seule une quantité finie peut en avoir été construite, mais nous pouvons imaginer qu’on en ajoute de plus en plus au fur et à mesure des besoins. De tels calculateurs présentent un intérêt théorique particulier et seront appelés calculateurs à capacité infinie.

L’idée d’un calculateur numérique est ancienne. Charles Babbage, professeur lucasien de mathématiques à Cambridge de 1828 à 1839, projeta une telle machine, appelée la Machine analytique, mais elle ne fut jamais achevée. Bien que Babbage eût toutes les idées essentielles, sa machine n’était pas alors une perspective très séduisante. La vitesse qui aurait été disponible aurait été nettement supérieure à celle d’un calculateur humain, mais quelque chose comme 100 fois plus lente que celle de la machine de Manchester, elle-même l’une des plus lentes parmi les machines modernes. Le stockage devait être purement mécanique, utilisant des roues et des cartes.

Le fait que la Machine analytique de Babbage devait être entièrement mécanique nous aidera à nous défaire d’une superstition. On attache souvent de l’importance au fait que les calculateurs numériques modernes sont électriques, et que le système nerveux l’est aussi. Puisque la machine de Babbage n’était pas électrique, et puisque tous les calculateurs numériques sont en un certain sens équivalents, nous voyons que cet emploi de l’électricité ne peut avoir d’importance théorique. Bien entendu l’électricité intervient d’ordinaire là où il s’agit de signalisation rapide, de sorte qu’il n’est pas surprenant que nous la trouvions dans ces deux connexions. Dans le système nerveux les phénomènes chimiques sont au moins aussi importants que les phénomènes électriques. Dans certains calculateurs le système de stockage est principalement acoustique. Le trait que constitue l’emploi de l’électricité apparaît ainsi comme une similitude seulement très superficielle. Si nous souhaitons trouver de telles similitudes nous devrions plutôt chercher du côté des analogies mathématiques de fonction.

5. Universalité des Calculateurs Numériques

Les calculateurs numériques considérés dans la dernière section peuvent être classés parmi les « machines à états discrets ». Ce sont les machines qui passent par bonds ou déclics soudains d’un état tout à fait défini à un autre. Ces états sont suffisamment différents pour que la possibilité de les confondre puisse être négligée. À strictement parler il n’existe pas de telles machines. Tout se meut en réalité continuellement. Mais il existe beaucoup d’espèces de machines qu’il est fécond de considérer comme étant des machines à états discrets. Par exemple, lorsqu’on considère les interrupteurs d’un système d’éclairage, c’est une fiction commode que de supposer que chaque interrupteur doit être nettement allumé ou nettement éteint. Il doit y avoir des positions intermédiaires, mais pour la plupart des fins nous pouvons les oublier. Comme exemple d’une machine à états discrets nous pourrions considérer une roue qui tourne avec un déclic de 120° une fois par seconde, mais qui peut être arrêtée par un levier pouvant être actionné de l’extérieur ; de plus une lampe doit s’allumer dans l’une des positions de la roue. Cette machine pourrait être décrite abstraitement comme suit. L’état interne de la machine (qui est décrit par la position de la roue) peut être q1, q2 ou q3. Il y a un signal d’entrée i0 ou i1 (position du levier). L’état interne à tout moment est déterminé par le dernier état et le signal d’entrée selon la table

Les signaux de sortie, seule indication visible de l’extérieur de l’état interne (la lumière), sont décrits par la table

Cet exemple est typique des machines à états discrets. Elles peuvent être décrites par de telles tables pourvu qu’elles n’aient qu’un nombre fini d’états possibles.

Il semblera qu’étant donné l’état initial de la machine et les signaux d’entrée il soit toujours possible de prédire tous les états futurs. Cela rappelle l’opinion de Laplace selon laquelle, à partir de l’état complet de l’univers à un moment du temps, tel qu’il est décrit par les positions et les vitesses de toutes les particules, il devrait être possible de prédire tous les états futurs. La prédiction que nous considérons est, toutefois, beaucoup plus proche de la praticabilité que celle considérée par Laplace. Le système de « l’univers dans son ensemble » est tel que de très petites erreurs dans les conditions initiales peuvent avoir un effet écrasant à un moment ultérieur. Le déplacement d’un seul électron d’un milliardième de centimètre à un moment pourrait faire la différence entre un homme tué par une avalanche un an plus tard, ou lui échappant. C’est une propriété essentielle des systèmes mécaniques que nous avons appelés « machines à états discrets » que ce phénomène ne s’y produise pas. Même lorsque nous considérons les machines physiques réelles au lieu des machines idéalisées, une connaissance raisonnablement exacte de l’état à un moment donné donne une connaissance raisonnablement exacte un nombre quelconque d’étapes plus tard.

Comme nous l’avons mentionné, les calculateurs numériques tombent dans la classe des machines à états discrets. Mais le nombre d’états dont une telle machine est capable est d’ordinaire énormément grand. Par exemple, le nombre pour la machine fonctionnant maintenant à Manchester est d’environ 2165 000, i.e. environ 1050 000. Comparons cela avec notre exemple de la roue à déclic décrite ci-dessus, qui avait trois états. Il n’est pas difficile de voir pourquoi le nombre d’états doit être si immense. Le calculateur comprend un stockage correspondant au papier utilisé par un calculateur humain. Il faut qu’il soit possible d’écrire dans le stockage n’importe laquelle des combinaisons de symboles qui auraient pu être écrites sur le papier. Pour simplifier supposons que seuls les chiffres de 0 à 9 soient utilisés comme symboles. Les variations dans l’écriture manuscrite ne sont pas prises en compte. Supposons qu’on accorde au calculateur 100 feuilles de papier contenant chacune 50 lignes pouvant chacune accueillir 30 chiffres. Alors le nombre d’états est 10100 × 50 × 30, i.e. 10150 000. C’est à peu près le nombre d’états de trois machines de Manchester réunies. Le logarithme en base deux du nombre d’états est d’ordinaire appelé la « capacité de stockage » de la machine. Ainsi la machine de Manchester a une capacité de stockage d’environ 165 000 et la machine à roue de notre exemple d’environ 1,6. Si l’on met deux machines ensemble leurs capacités doivent être additionnées pour obtenir la capacité de la machine résultante. Cela conduit à la possibilité d’énoncés tels que : « La machine de Manchester contient 64 pistes magnétiques ayant chacune une capacité de 2560, huit tubes électroniques ayant une capacité de 1280. Le stockage divers s’élève à environ 300, ce qui fait un total de 174 380. »

Étant donnée la table correspondant à une machine à états discrets il est possible de prédire ce qu’elle fera. Il n’y a aucune raison pour que ce calcul ne soit pas effectué au moyen d’un calculateur numérique. Pourvu qu’il puisse être effectué assez rapidement le calculateur numérique pourrait reproduire le comportement de n’importe quelle machine à états discrets. Le jeu de l’imitation pourrait alors être joué avec la machine en question (en tant que B) et le calculateur numérique imitateur (en tant que A) et l’interrogateur serait incapable de les distinguer. Bien entendu le calculateur numérique doit avoir une capacité de stockage adéquate aussi bien que fonctionner assez vite. De plus il doit être programmé à nouveau pour chaque nouvelle machine qu’il est souhaité de reproduire.

Cette propriété spéciale des calculateurs numériques, à savoir qu’ils peuvent reproduire n’importe quelle machine à états discrets, s’exprime en disant qu’ils sont des machines universelles. L’existence de machines possédant cette propriété a pour conséquence importante que, les considérations de vitesse mises à part, il est inutile de concevoir diverses nouvelles machines pour effectuer divers processus de calcul. Ils peuvent tous être effectués avec un seul calculateur numérique, convenablement programmé pour chaque cas. On verra qu’il résulte de cela que tous les calculateurs numériques sont en un certain sens équivalents.

Nous pouvons maintenant considérer de nouveau le point soulevé à la fin du § 3. Il a été suggéré à titre provisoire que la question, « Les machines peuvent-elles penser ? » devrait être remplacée par « Existe-t-il des calculateurs numériques imaginables qui figureraient bien dans le jeu de l’imitation ? » Si nous le souhaitons nous pouvons rendre cela superficiellement plus général et demander « Existe-t-il des machines à états discrets qui figureraient bien ? » Mais eu égard à la propriété d’universalité nous voyons que l’une ou l’autre de ces questions est équivalente à celle-ci, « Fixons notre attention sur un calculateur numérique particulier C. Est-il vrai qu’en modifiant ce calculateur pour qu’il ait un stockage adéquat, en augmentant convenablement sa vitesse d’action, et en le munissant d’un programme approprié, on puisse faire jouer à C d’une manière satisfaisante le rôle de A dans le jeu de l’imitation, le rôle de B étant tenu par un homme ? »

6. Points de Vue Contraires sur la Question Principale

Nous pouvons maintenant considérer que le terrain a été dégagé et nous sommes prêts à passer au débat sur notre question, « Les machines peuvent-elles penser ? » et sur la variante qui en a été citée à la fin de la dernière section. Nous ne pouvons pas abandonner tout à fait la forme originale du problème, car les opinions différeront quant au caractère approprié de la substitution et nous devons au moins écouter ce qui a à être dit à cet égard.

Il simplifiera les choses pour le lecteur si j’explique d’abord quelles sont mes propres croyances en la matière. Considérons d’abord la forme plus exacte de la question. Je crois que dans environ cinquante ans il sera possible de programmer des calculateurs, avec une capacité de stockage d’environ 109, de façon à leur faire jouer le jeu de l’imitation si bien qu’un interrogateur moyen n’aura pas plus de 70 pour cent de chances de faire la bonne identification après cinq minutes d’interrogation. Je crois que la question originale, « Les machines peuvent-elles penser ? » est trop dénuée de sens pour mériter discussion. Néanmoins je crois qu’à la fin du siècle l’usage des mots et l’opinion générale des gens instruits auront tellement changé que l’on pourra parler de machines pensantes sans s’attendre à être contredit. Je crois en outre qu’aucun but utile n’est servi en dissimulant ces croyances. La vue populaire selon laquelle les savants procèdent inexorablement de fait bien établi en fait bien établi, sans jamais être influencés par quelque conjecture non prouvée, est tout à fait erronée. Pourvu que soit rendu clair quels sont les faits prouvés et quelles sont les conjectures, il ne peut en résulter aucun mal. Les conjectures sont de grande importance puisqu’elles suggèrent des lignes de recherche utiles.

Je passe maintenant à la considération des opinions opposées aux miennes.

(1) L’Objection Théologique

Penser est une fonction de l’âme immortelle de l’homme. Dieu a donné une âme immortelle à chaque homme et à chaque femme, mais non à quelque autre animal ni aux machines. Donc aucun animal ni aucune machine ne peut penser.

Je suis incapable d’accepter aucune partie de cela, mais j’essaierai de répondre en termes théologiques. Je trouverais l’argument plus convaincant si les animaux étaient classés avec les hommes, car il y a à mon esprit une plus grande différence entre l’animé typique et l’inanimé qu’entre l’homme et les autres animaux. Le caractère arbitraire de la vue orthodoxe devient plus clair si nous considérons comment elle pourrait apparaître à un membre de quelque autre communauté religieuse. Comment les chrétiens considèrent-ils la vue musulmane selon laquelle les femmes n’ont pas d’âme ? Mais laissons ce point de côté et revenons à l’argument principal. Il m’apparaît que l’argument cité ci-dessus implique une sérieuse restriction de la toute-puissance du Tout-Puissant. Il est admis qu’il est certaines choses qu’Il ne peut faire, telles que faire que un soit égal à deux, mais ne devrions-nous pas croire qu’Il a la liberté de conférer une âme à un éléphant s’Il le juge bon ? Nous pourrions nous attendre à ce qu’Il n’exerce ce pouvoir qu’en conjonction avec une mutation qui doterait l’éléphant d’un cerveau convenablement amélioré pour servir aux besoins de cette âme. Un argument d’une forme exactement semblable peut être fait pour le cas des machines. Il peut sembler différent parce qu’il est plus difficile à « avaler ». Mais cela signifie en réalité seulement que nous pensons qu’il serait moins probable qu’Il juge les circonstances appropriées pour conférer une âme. Les circonstances en question sont discutées dans le reste de cet article. En essayant de construire de telles machines nous n’usurperions pas irrévérencieusement Son pouvoir de créer des âmes, pas plus que nous ne le faisons dans la procréation des enfants : plutôt sommes-nous, dans l’un ou l’autre cas, les instruments de Sa volonté, fournissant des demeures pour les âmes qu’Il crée.1

Cependant ceci n’est que spéculation. Je ne suis guère impressionné par les arguments théologiques, quels que soient les appuis qu’ils servent. De tels arguments se sont souvent révélés insatisfaisants dans le passé. Au temps de Galilée on soutenait que les textes « Et le soleil s’arrêta … et ne se hâta point de se coucher durant presque tout un jour » (Josué x. 13) et « Il a posé les fondements de la terre, afin qu’elle ne fût jamais ébranlée » (Psaume cv. 5) constituaient une réfutation adéquate de la théorie copernicienne. Avec notre connaissance présente un tel argument apparaît futile. Lorsque cette connaissance n’était pas disponible il produisait une impression tout autre.

(2) L’Objection de la « Tête dans le Sable »

« Les conséquences du fait que les machines pensent seraient trop affreuses. Espérons et croyons qu’elles ne peuvent pas faire cela. »

Cet argument est rarement exprimé tout à fait aussi ouvertement que sous la forme ci-dessus. Mais il affecte la plupart d’entre nous qui y pensons tant soit peu. Nous aimons croire que l’Homme est d’une certaine manière subtile supérieur au reste de la création. Il vaut mieux qu’il puisse être montré nécessairement supérieur, car alors il n’y a aucun danger qu’il perde sa position dominante. La popularité de l’argument théologique est clairement liée à ce sentiment. Il est probable qu’il soit assez fort chez les gens intellectuels, puisqu’ils attachent plus de prix que les autres à la puissance de penser, et sont plus enclins à fonder sur cette puissance leur croyance en la supériorité de l’Homme.

Je ne pense pas que cet argument soit suffisamment substantiel pour requérir réfutation. La consolation serait plus appropriée : peut-être faudrait-il la chercher dans la transmigration des âmes.

(3) L’Objection Mathématique

Il existe un certain nombre de résultats de logique mathématique qui peuvent être utilisés pour montrer qu’il y a des limitations aux puissances des machines à états discrets. Le plus connu de ces résultats est connu sous le nom de théorème de Gödel,2 et montre que dans tout système logique suffisamment puissant on peut formuler des énoncés qui ne peuvent être ni prouvés ni réfutés à l’intérieur du système, à moins peut-être que le système lui-même ne soit inconsistant. Il y a d’autres résultats, en certains égards semblables, dus à Church, Kleene, Rosser et Turing. Ce dernier résultat est le plus commode à considérer, puisqu’il se rapporte directement aux machines, alors que les autres ne peuvent être utilisés que dans un argument comparativement indirect : par exemple si l’on veut utiliser le théorème de Gödel nous avons en outre besoin de quelque moyen de décrire les systèmes logiques en termes de machines, et les machines en termes de systèmes logiques. Le résultat en question se rapporte à un type de machine qui est essentiellement un calculateur numérique à capacité infinie. Il énonce qu’il est certaines choses qu’une telle machine ne peut pas faire. Si elle est montée de manière à donner des réponses à des questions comme dans le jeu de l’imitation, il y aura certaines questions auxquelles elle donnera soit une réponse fausse, soit aucune réponse du tout, quel que soit le temps accordé pour répondre. Il peut bien entendu y avoir beaucoup de telles questions, et des questions auxquelles une machine ne peut répondre peuvent être répondues de manière satisfaisante par une autre. Nous supposons naturellement pour le présent que les questions sont de l’espèce à laquelle une réponse “Oui” ou “Non” est appropriée, plutôt que des questions telles que « Que pensez-vous de Picasso ? » Les questions auxquelles nous savons que les machines doivent échouer sont de ce type : « Considérez la machine spécifiée comme suit … . Cette machine répondra-t-elle jamais “Oui” à une quelconque question ? » Les points doivent être remplacés par une description de quelque machine dans une forme standard, qui pourrait être quelque chose comme celle utilisée au § 5. Lorsque la machine décrite porte une certaine relation comparativement simple à la machine qui est soumise à l’interrogation, on peut montrer que la réponse est soit fausse soit non fournie. Tel est le résultat mathématique : on soutient qu’il prouve une incapacité des machines à laquelle l’intellect humain n’est pas soumis.

La réponse courte à cet argument est que, bien qu’il soit établi qu’il y a des limitations aux puissances de toute machine particulière, on a seulement affirmé, sans la moindre espèce de preuve, qu’aucune limitation de ce genre ne s’applique à l’intellect humain. Mais je ne pense pas que cette vue puisse être écartée aussi légèrement. Chaque fois qu’on pose à l’une de ces machines la question critique appropriée, et qu’elle donne une réponse déterminée, nous savons que cette réponse doit être fausse, et cela nous donne un certain sentiment de supériorité. Ce sentiment est-il illusoire ? Il est sans doute tout à fait authentique, mais je ne pense pas qu’il faille lui attacher trop d’importance. Nous donnons nous-mêmes bien trop souvent de mauvaises réponses à des questions pour être justifiés à nous réjouir beaucoup d’une telle preuve de faillibilité de la part des machines. De plus notre supériorité ne peut être ressentie, en une telle occasion, qu’en relation à la seule machine sur laquelle nous avons remporté notre petit triomphe. Il ne saurait être question de triompher simultanément de toutes les machines. Bref, donc, il pourrait y avoir des hommes plus intelligents que n’importe quelle machine donnée, mais alors encore il pourrait y avoir d’autres machines plus intelligentes encore, et ainsi de suite.

Ceux qui s’en tiennent à l’argument mathématique seraient, je pense, pour la plupart disposés à accepter le jeu de l’imitation comme base de discussion. Ceux qui croient aux deux objections précédentes ne seraient probablement intéressés par aucun critère.

(4) L’Argument tiré de la Conscience

Cet argument est très bien exprimé dans la conférence Lister de 1949 du professeur Jefferson, dont je cite. « Ce n’est que lorsqu’une machine pourra écrire un sonnet ou composer un concerto à cause des pensées et des émotions ressenties, et non par la chute fortuite de symboles, que nous pourrons admettre que machine égale cerveau — c’est-à-dire non seulement l’écrire, mais savoir qu’elle l’a écrit. Aucun mécanisme ne pourrait éprouver (et non pas simplement signaler artificiellement, [car c’est] un dispositif facile à mettre au point) du plaisir de ses succès, du chagrin lorsque ses lampes grillent, être réchauffé par la flatterie, être rendu misérable par ses erreurs, être charmé par le sexe, être en colère ou déprimé lorsqu’il ne peut obtenir ce qu’il veut. »

Cet argument apparaît comme un déni de la validité de notre test. Selon la forme la plus extrême de cette vue la seule manière par laquelle on pourrait être sûr qu’une machine pense serait d’être la machine et de se sentir penser soi-même. On pourrait alors décrire ces sentiments au monde, mais bien sûr personne n’aurait de raison d’y prêter la moindre attention. De même selon cette vue la seule manière de savoir qu’un homme pense est d’être cet homme particulier. C’est en fait le point de vue solipsiste. Cela peut être la vue la plus logique à soutenir mais il rend difficile la communication des idées. A est porté à croire « A pense mais B ne pense pas » tandis que B croit « B pense mais A ne pense pas ». Au lieu d’argumenter continuellement sur ce point il est d’usage d’avoir la convention polie que tout le monde pense.

Je suis sûr que le professeur Jefferson ne souhaite pas adopter le point de vue extrême et solipsiste. Il serait probablement tout disposé à accepter le jeu de l’imitation comme test. Le jeu (avec le joueur B omis) est fréquemment utilisé en pratique sous le nom de viva voce pour découvrir si quelqu’un comprend réellement quelque chose ou l’a « appris comme un perroquet ». Écoutons une partie d’un tel viva voce :

Interrogateur : Dans le premier vers de votre sonnet, qui dit « Shall I compare thee to a summer’s day », « a spring day » ne ferait-il pas aussi bien, voire mieux ?

Témoin : Cela ne rimerait pas.

Interrogateur : Que diriez-vous de « a winter’s day » ? Cela rimerait très bien.

Témoin : Oui, mais personne ne veut être comparé à un jour d’hiver.

Interrogateur : Diriez-vous que M. Pickwick vous rappelait Noël ?

Témoin : D’une certaine manière.

Interrogateur : Pourtant Noël est un jour d’hiver, et je ne pense pas que M. Pickwick verrait d’un mauvais œil la comparaison.

Témoin : Je ne pense pas que vous soyez sérieux. Par un jour d’hiver on entend un jour d’hiver typique, plutôt qu’un jour particulier comme Noël.

Et ainsi de suite. Que dirait le professeur Jefferson si la machine écrivant des sonnets était capable de répondre ainsi dans le viva voce ? Je ne sais pas s’il considérerait la machine comme « signalant simplement artificiellement » ces réponses, mais si les réponses étaient aussi satisfaisantes et soutenues que dans le passage ci-dessus je ne pense pas qu’il la décrirait comme « un dispositif facile à mettre au point ». Cette expression est, je pense, destinée à couvrir des dispositifs tels que l’inclusion dans la machine d’un enregistrement de quelqu’un lisant un sonnet, avec des commutateurs appropriées pour le mettre en route de temps en temps.

Bref donc, je pense que la plupart de ceux qui soutiennent l’argument tiré de la conscience pourraient être persuadés de l’abandonner plutôt que d’être forcés dans la position solipsiste. Ils seront alors probablement disposés à accepter notre test.

Je ne souhaite pas donner l’impression que je pense qu’il n’y a aucun mystère dans la conscience. Il y a, par exemple, quelque chose de paradoxal lié à toute tentative de la localiser. Mais je ne pense pas que ces mystères aient nécessairement besoin d’être résolus avant que nous puissions répondre à la question dont nous nous occupons dans cet article.

(5) Les Arguments tirés de Diverses Incapacités

Ces arguments prennent la forme, « Je vous accorde que vous pouvez faire faire aux machines toutes les choses que vous avez mentionnées mais vous ne serez jamais capable d’en faire une qui fasse X ». De nombreuses propriétés X sont suggérées à cet égard. J’en offre une sélection :

Être aimable, plein de ressources, beau, amical (p. 448), avoir de l’initiative, avoir le sens de l’humour, distinguer le bien du mal, faire des erreurs (p. 448), tomber amoureux, aimer les fraises à la crème (p. 448), faire tomber quelqu’un amoureux d’elle, apprendre par l’expérience (pp. 456 sq.), employer les mots correctement, être le sujet de sa propre pensée (p. 449), avoir autant de diversité de comportement qu’un homme, faire quelque chose de réellement nouveau (p. 450). (Certaines de ces incapacités sont considérées spécialement comme l’indiquent les numéros de page.)

On n’offre d’ordinaire aucun appui à ces affirmations. Je crois qu’elles sont pour la plupart fondées sur le principe de l’induction scientifique. Un homme a vu des milliers de machines dans sa vie. D’après ce qu’il en voit il tire un certain nombre de conclusions générales. Elles sont laides, chacune est conçue pour une fin très limitée, lorsqu’on les requiert pour une fin très légèrement différente elles sont inutiles, la variété de comportement de chacune d’elles est très petite, etc., etc. Naturellement il conclut que ce sont là des propriétés nécessaires des machines en général. Beaucoup de ces limitations sont associées à la très petite capacité de stockage de la plupart des machines. (Je suppose que l’idée de capacité de stockage est étendue d’une certaine manière de façon à couvrir des machines autres que les machines à états discrets. La définition exacte importe peu puisque nulle exactitude mathématique n’est revendiquée dans la présente discussion.) Il y a quelques années, lorsqu’on avait fort peu entendu parler des calculateurs numériques, il était possible de susciter beaucoup d’incrédulité à leur sujet, si l’on mentionnait leurs propriétés sans décrire leur construction. Cela était vraisemblablement dû à une application semblable du principe de l’induction scientifique. Ces applications du principe sont bien entendu largement inconscientes. Lorsqu’un enfant brûlé craint le feu et montre qu’il le craint en l’évitant, je dirais qu’il appliquait l’induction scientifique. (Je pourrais bien entendu aussi décrire son comportement de beaucoup d’autres manières.) Les œuvres et les coutumes de l’humanité ne semblent pas être une matière très appropriée à laquelle appliquer l’induction scientifique. Une très grande partie de l’espace-temps doit être examinée si l’on veut obtenir des résultats dignes de confiance. Autrement nous pouvons décider, comme le font la plupart des enfants anglais, que tout le monde parle anglais, et qu’il est sot d’apprendre le français.

Il y a toutefois des remarques spéciales à faire au sujet de beaucoup des incapacités qui ont été mentionnées. L’incapacité à aimer les fraises à la crème a peut-être frappé le lecteur par son caractère futile. Il serait peut-être possible de faire qu’une machine aime ce délicieux mets, mais toute tentative pour le lui faire aimer serait idiote. Ce qui est important dans cette incapacité, c’est qu’elle contribue à certaines des autres incapacités, e.g. à la difficulté de voir se produire entre l’homme et la machine la même sorte de cordialité qu’entre homme blanc et homme blanc, ou entre homme noir et homme noir.

L’affirmation selon laquelle « les machines ne peuvent pas faire d’erreurs » paraît curieuse. On est tenté de répliquer, « En sont-elles pires pour autant ? » Mais adoptons une attitude plus sympathique, et essayons de voir ce que l’on veut réellement dire. Je pense que cette critique peut être expliquée en termes du jeu de l’imitation. On soutient que l’interrogateur pourrait distinguer la machine de l’homme simplement en leur soumettant un certain nombre de problèmes d’arithmétique. La machine serait démasquée à cause de son exactitude mortelle. La réponse à cela est simple. La machine (programmée pour jouer le jeu) n’essaierait pas de donner les bonnes réponses aux problèmes d’arithmétique. Elle introduirait délibérément des erreurs d’une manière calculée pour embrouiller l’interrogateur. Une défaillance mécanique se montrerait probablement par une décision inappropriée quant à l’espèce d’erreur à faire en arithmétique. Même cette interprétation de la critique n’est pas suffisamment sympathique. Mais nous ne pouvons pas nous offrir l’espace pour s’y attarder davantage. Il me semble que cette critique dépend d’une confusion entre deux espèces d’erreurs. Nous pouvons les appeler « erreurs de fonctionnement » et « erreurs de conclusion ». Les erreurs de fonctionnement sont dues à quelque défaut mécanique ou électrique qui fait que la machine se comporte autrement qu’elle n’a été conçue pour le faire. Dans les discussions philosophiques on aime ignorer la possibilité de telles erreurs ; on discute donc de « machines abstraites ». Ces machines abstraites sont des fictions mathématiques plutôt que des objets physiques. Par définition elles sont incapables d’erreurs de fonctionnement. En ce sens nous pouvons dire véritablement que « les machines ne peuvent jamais faire d’erreurs ». Les erreurs de conclusion ne peuvent surgir que lorsqu’un sens est attaché aux signaux de sortie de la machine. La machine pourrait, par exemple, taper des équations mathématiques, ou des phrases en anglais. Lorsqu’une proposition fausse est tapée nous disons que la machine a commis une erreur de conclusion. Il n’y a clairement aucune raison du tout de dire qu’une machine ne peut pas faire cette sorte d’erreur. Elle pourrait ne rien faire d’autre que taper de manière répétée « 0 = 1 ». Pour prendre un exemple moins pervers, elle pourrait avoir quelque méthode pour tirer des conclusions par induction scientifique. Nous devons nous attendre à ce qu’une telle méthode conduise occasionnellement à des résultats erronés.

L’affirmation qu’une machine ne peut pas être le sujet de sa propre pensée ne peut bien entendu recevoir de réponse que s’il peut être montré que la machine a quelque pensée ayant quelque sujet. Néanmoins « le sujet des opérations d’une machine » semble bien vouloir dire quelque chose, au moins pour les gens qui ont affaire à elle. Si, par exemple, la machine essayait de trouver une solution de l’équation x2 − 40x − 11 = 0 on serait tenté de décrire cette équation comme faisant partie du sujet de la machine à ce moment-là. En ce sens une machine peut indubitablement être son propre sujet. Elle peut être utilisée pour aider à composer ses propres programmes, ou pour prédire l’effet de modifications dans sa propre structure. En observant les résultats de son propre comportement elle peut modifier ses propres programmes de façon à atteindre quelque but plus efficacement. Ce sont là des possibilités du proche avenir, plutôt que des rêves utopiques.

La critique selon laquelle une machine ne peut pas avoir beaucoup de diversité de comportement n’est qu’une manière de dire qu’elle ne peut pas avoir beaucoup de capacité de stockage. Jusqu’à une date assez récente une capacité de stockage de mille chiffres même était très rare.

Les critiques que nous considérons ici sont souvent des formes déguisées de l’argument tiré de la conscience. D’ordinaire si l’on soutient qu’une machine peut faire l’une de ces choses, et qu’on décrit l’espèce de méthode que la machine pourrait employer, on ne produira pas grande impression. On pense que la méthode (quelle qu’elle puisse être, car il faut qu’elle soit mécanique) est en réalité assez basique. Comparez la parenthèse dans la déclaration de Jefferson citée p. 21.

(6) L’Objection de Lady Lovelace

Nos informations les plus détaillées sur la Machine analytique de Babbage proviennent d’un mémoire de Lady Lovelace. Elle y déclare : « La Machine analytique n’a aucune prétention à originer quoi que ce soit. Elle peut faire n’importe quoi de ce que nous savons lui ordonner d’effectuer » (ses italiques). Cette déclaration est citée par Hartree (p. 70), qui ajoute : « Cela n’implique pas qu’il ne puisse pas être possible de construire un équipement électronique qui “penserait par lui-même”, ou dans lequel, en termes biologiques, on pourrait mettre en place un réflexe conditionné, qui servirait de base à “l’apprentissage”. Que cela soit possible en principe ou non est une question stimulante et excitante, suggérée par quelques-uns de ces développements récents. Mais il ne semblait pas que les machines construites ou projetées à cette époque eussent cette propriété. »

Je suis tout à fait d’accord avec Hartree sur ce point. On remarquera qu’il n’affirme pas que les machines en question n’avaient pas eu la propriété, mais plutôt que les preuves dont disposait Lady Lovelace ne l’encourageaient pas à croire qu’elles l’avaient. Il est tout à fait possible que les machines en question aient en un sens possédé cette propriété. Car supposons qu’une certaine machine à états discrets possède cette propriété. La Machine analytique était un calculateur numérique universel, de sorte que, si sa capacité de mémoire et sa vitesse avaient été adéquates, elle aurait pu, par une programmation convenable, être amenée à reproduire la machine en question. Cet argument ne vint probablement pas à l’esprit de la Comtesse ni à celui de Babbage. En tout cas ils n’étaient nullement obligés de réclamer tout ce qui pouvait l’être.

Toute cette question sera de nouveau examinée sous la rubrique des machines apprenantes.

Une variante de l’objection de Lady Lovelace affirme qu’une machine ne peut « jamais faire quoi que ce soit de vraiment nouveau ». Cela peut être paré en un instant par le dicton, « Il n’y a rien de nouveau sous le soleil ». Qui peut être certain que le « travail original » qu’il a accompli n’était pas simplement la croissance de la semence plantée en lui par l’enseignement, ou l’effet de suivre des principes généraux bien connus ? Une meilleure variante de l’objection dit qu’une machine ne peut jamais « nous prendre par surprise ». Cette affirmation est un défi plus direct et peut être rencontrée directement. Les machines me prennent très fréquemment par surprise. C’est largement parce que je n’effectue pas assez de calcul pour décider à quoi m’attendre de leur part, ou plutôt parce que, bien que j’effectue un calcul, je le fais d’une manière hâtive et négligée, en prenant des risques. Il m’arrive de me dire, « Je suppose que la tension ici devrait être la même que là : de toute façon supposons que ce soit le cas. » Naturellement je me trompe souvent, et le résultat est pour moi une surprise car au moment où l’expérience est faite ces hypothèses ont été oubliées. Ces aveux m’exposent à des remontrances sur le sujet de mes mauvaises habitudes, mais ne jettent aucun doute sur ma crédibilité lorsque je témoigne des surprises que j’éprouve.

Je ne m’attends pas à ce que cette réponse réduise mon critique au silence. Il dira probablement que de telles surprises sont dues à quelque acte mental créateur de ma part, et ne font nullement honneur à la machine. Cela nous ramène à l’argument tiré de la conscience, et loin de l’idée de surprise. C’est une ligne d’argument que nous devons considérer comme close, mais il vaut peut-être la peine de remarquer que l’appréciation de quelque chose comme surprenant requiert tout autant d’« acte mental créateur » que l’événement surprenant provienne d’un homme, d’un livre, d’une machine, ou de n’importe quoi d’autre.

La vue selon laquelle les machines ne peuvent pas donner lieu à des surprises est due, je crois, à un sophisme auquel les philosophes et les mathématiciens sont particulièrement sujets. C’est l’hypothèse que, dès qu’un fait est présenté à un esprit, toutes les conséquences de ce fait jaillissent dans l’esprit simultanément avec lui. C’est une hypothèse très utile dans beaucoup de circonstances, mais on oublie trop facilement qu’elle est fausse. Une conséquence naturelle de cela est qu’on suppose alors qu’il n’y a aucune vertu dans le simple travail qui consiste à tirer les conséquences à partir de données et de principes généraux.

(7) L’Argument tiré de la Continuité du Système Nerveux

Le système nerveux n’est certainement pas une machine à états discrets. Une petite erreur dans l’information sur la taille d’une impulsion nerveuse venant frapper un neurone, peut faire une grande différence dans la taille de l’impulsion sortante. On peut soutenir que, cela étant, on ne peut pas espérer être capable de reproduire le comportement du système nerveux au moyen d’un système à états discrets.

Il est vrai qu’une machine à états discrets doit être différente d’une machine continue. Mais si nous adhérons aux conditions du jeu de l’imitation, l’interrogateur ne pourra tirer aucun avantage de cette différence. La situation peut être rendue plus claire si nous considérons quelque autre machine continue plus simple. Un analyseur différentiel fera très bien l’affaire. (Un analyseur différentiel est une certaine espèce de machine, non du type à états discrets, utilisée pour certaines espèces de calcul.) Certains d’entre eux fournissent leurs réponses sous une forme dactylographiée, et sont ainsi appropriés pour prendre part au jeu. Il ne serait pas possible à un calculateur numérique de prédire exactement quelles réponses l’analyseur différentiel donnerait à un problème, mais il serait tout à fait capable de donner la bonne sorte de réponse. Par exemple, si on lui demandait de donner la valeur de π (en réalité environ 3.1416) il serait raisonnable de choisir au hasard entre les valeurs 3.12, 3.13, 3.14, 3.15, 3.16 avec les probabilités 0.05, 0.15, 0.55, 0.19, 0.06 (disons). Dans ces circonstances il serait très difficile pour l’interrogateur de distinguer l’analyseur différentiel du calculateur numérique.

(8) L’Argument tiré de l’Informalité du Comportement

Il n’est pas possible de produire un ensemble de règles prétendant décrire ce qu’un homme devrait faire dans tout ensemble concevable de circonstances. On pourrait par exemple avoir une règle disant qu’il faut s’arrêter lorsqu’on voit un feu rouge, et partir lorsqu’on voit un feu vert, mais que faire si par quelque défaut les deux apparaissent ensemble ? On peut peut-être décider qu’il est plus sûr de s’arrêter. Mais quelque difficulté supplémentaire peut très bien surgir plus tard de cette décision. Tenter de fournir des règles de conduite couvrant toute éventualité, même celles qui surgissent des feux de circulation, paraît être impossible. Avec tout cela je suis d’accord.

De là on soutient que nous ne pouvons pas être des machines. J’essaierai de reproduire l’argument, mais je crains de lui rendre à peine justice. Cela pourrait donner quelque chose comme ceci. « Si chaque homme avait un ensemble défini de règles de conduite par lesquelles il régulait sa vie il ne vaudrait pas mieux qu’une machine. Mais il n’existe pas de telles règles, donc les hommes ne peuvent pas être des machines. » Le moyen terme non distribué est flagrant. Je ne pense pas que l’argument soit jamais tout à fait formulé ainsi, mais je crois que c’est néanmoins l’argument utilisé. Il peut toutefois y avoir une certaine confusion entre « règles de conduite » et « lois de comportement » qui obscurcisse la question. Par « règles de conduite » j’entends des préceptes tels que « Arrêtez-vous si vous voyez des feux rouges », sur lesquels on peut agir, et dont on peut être conscient. Par « lois de comportement » j’entends des lois de la nature telles qu’elles s’appliquent au corps d’un homme, par exemple « si on le pince il couinera ». Si nous substituons dans l’argument cité « lois de comportement qui régulent sa vie » à « règles de conduite par lesquelles il régule sa vie » le moyen terme non distribué n’est plus insurmontable. Car nous croyons qu’il n’est pas seulement vrai qu’être régulé par des lois de comportement implique d’être une sorte de machine (bien que pas nécessairement une machine à états discrets), mais qu’inversement être une telle machine implique être régulé par de telles lois. Cependant nous ne pouvons pas nous convaincre aussi aisément de l’absence de lois complètes de comportement que de l’absence de règles complètes de conduite. La seule manière que nous connaissions de trouver de telles lois est l’observation scientifique, et nous ne connaissons certainement aucune circonstance dans laquelle nous pourrions dire : « Nous avons assez cherché. Il n’existe pas de telles lois. »

Nous pouvons démontrer plus vigoureusement qu’une telle affirmation serait injustifiée. Car supposons que nous puissions être sûrs de trouver de telles lois si elles existaient. Alors étant donnée une machine à états discrets il devrait certainement être possible de découvrir par observation suffisamment de choses à son sujet pour prédire son comportement futur, et cela dans un temps raisonnable, disons mille ans. Mais cela ne semble pas être le cas. J’ai mis en place sur le calculateur de Manchester un petit programme n’utilisant que 1000 unités de stockage, par lequel la machine, à laquelle on fournit un nombre de seize chiffres, répond par un autre dans les deux secondes. Je défierais quiconque d’apprendre à partir de ces réponses suffisamment de choses sur le programme pour être capable de prédire quelque réponse que ce soit à des valeurs non essayées.

(9) L’Argument tiré de la Perception Extrasensorielle

Je suppose le lecteur familier avec l’idée de perception extrasensorielle, et la signification de ses quatre éléments, à savoir télépathie, clairvoyance, précognition et psychokinèse. Ces phénomènes troublants semblent renier toutes nos idées scientifiques habituelles. Comme nous aimerions les discréditer ! Malheureusement les preuves statistiques, du moins pour la télépathie, sont accablantes. Il est très difficile de réarranger ses idées de façon à faire place à ces faits nouveaux. Une fois qu’on les a acceptés il ne semble pas un très grand pas de croire aux fantômes et aux croquemitaines. L’idée que nos corps se meuvent simplement selon les lois connues de la physique, avec quelques autres encore non découvertes mais assez semblables, serait l’une des premières à disparaître.

Cet argument est à mon esprit un argument plutôt fort. On peut répondre que beaucoup de théories scientifiques semblent rester opérantes dans la pratique, en dépit de leur conflit avec la P.E.S. ; qu’en fait on s’en tire très bien si on l’oublie. C’est là une bien froide consolation, et l’on craint que penser soit justement l’espèce de phénomène pour laquelle la P.E.S. peut être particulièrement pertinente.

Un argument plus spécifique fondé sur la P.E.S. pourrait donner comme suit : « Jouons au jeu de l’imitation, en utilisant comme témoins un homme bon récepteur télépathique, et un calculateur numérique. L’interrogateur peut poser des questions telles que “De quelle couleur est la carte que je tiens dans ma main droite ?” L’homme donne par télépathie ou par clairvoyance la bonne réponse 130 fois sur 400 cartes. La machine ne peut que deviner au hasard, et peut-être en obtient 104 de justes, de sorte que l’interrogateur fait la bonne identification. » Il s’ouvre ici une possibilité intéressante. Supposons que le calculateur numérique contienne un générateur de nombres aléatoires. Il sera alors naturel de s’en servir pour décider quelle réponse donner. Mais alors le générateur de nombres aléatoires sera soumis aux pouvoirs psychokinétiques de l’interrogateur. Peut-être cette psychokinèse pourrait-elle faire que la machine devine juste plus souvent qu’on ne l’attendrait d’après un calcul de probabilités, de sorte que l’interrogateur pourrait encore être incapable de faire la bonne identification. D’un autre côté il pourrait être capable de deviner juste sans aucun questionnement, par clairvoyance. Avec la P.E.S. tout peut arriver.

Si la télépathie est admise il sera nécessaire de resserrer notre test. La situation pourrait être regardée comme analogue à celle qui se produirait si l’interrogateur se parlait à lui-même et que l’un des compétiteurs écoutait avec l’oreille collée au mur. Mettre les compétiteurs dans une « pièce à l’épreuve de la télépathie » satisferait toutes les exigences.

7. Machines Apprenantes

Le lecteur aura anticipé que je n’ai pas d’arguments de nature positive très convaincants pour appuyer mes vues. Si j’en avais je ne me serais pas donné tant de peine pour signaler les sophismes des points de vue contraires. Les quelques preuves que j’ai, je vais maintenant les donner.

Revenons un instant à l’objection de Lady Lovelace, qui affirmait que la machine ne peut faire que ce que nous lui disons de faire. On pourrait dire qu’un homme peut « injecter » une idée dans la machine, et qu’elle répondra jusqu’à un certain point puis retombera dans la quiescence, comme une corde de piano frappée par un marteau. Une autre comparaison serait une pile atomique de taille inférieure à la taille critique : une idée injectée correspondrait à un neutron entrant dans la pile de l’extérieur. Chaque neutron de ce genre causera une certaine perturbation qui finit par s’éteindre. Si, toutefois, la taille de la pile est suffisamment accrue, la perturbation causée par un tel neutron entrant ira très vraisemblablement en s’accroissant encore et encore jusqu’à ce que toute la pile soit détruite. Existe-t-il un phénomène correspondant pour les esprits, et en existe-t-il un pour les machines ? Il semble bien qu’il en existe un pour l’esprit humain. La majorité de ceux-ci semblent être « sous-critiques », i.e. correspondant dans cette analogie à des piles de taille sous-critique. Une idée présentée à un tel esprit donnera naissance en moyenne à moins d’une idée en réponse. Une assez petite proportion est super-critique. Une idée présentée à un tel esprit peut donner naissance à toute une « théorie » consistant en idées secondaires, tertiaires et plus éloignées encore. Les esprits animaux semblent être très nettement sous-critiques. En nous en tenant à cette analogie nous demandons, « Une machine peut-elle être rendue super-critique ? »

L’analogie de « la peau d’un oignon » est aussi utile. En considérant les fonctions de l’esprit ou du cerveau nous trouvons certaines opérations que nous pouvons expliquer en termes purement mécaniques. Nous disons que cela ne correspond pas à l’esprit réel : c’est une sorte de peau qu’il nous faut enlever si nous voulons trouver l’esprit réel. Mais ensuite dans ce qui reste nous trouvons encore une peau qu’il faut enlever, et ainsi de suite. En procédant de cette manière arrivons-nous jamais à l’« esprit réel », ou arrivons-nous finalement à la peau qui n’a rien dedans ? Dans ce dernier cas l’esprit entier est mécanique. (Il ne serait toutefois pas une machine à états discrets. Nous en avons discuté.)

Ces deux derniers paragraphes ne prétendent pas être des arguments convaincants. Ils devraient plutôt être décrits comme des « déclamations tendant à produire la croyance ».

Le seul appui réellement satisfaisant qui puisse être donné à la vue exprimée au début du § 6, sera celui que fournira le fait d’attendre la fin du siècle, puis de faire l’expérience décrite. Mais que pouvons-nous dire en attendant ? Quelles mesures devraient être prises maintenant si l’expérience doit réussir ?

Comme je l’ai expliqué, le problème est principalement un problème de programmation. Des progrès en ingénierie devront aussi être accomplis, mais il paraît improbable qu’ils ne soient pas adéquats aux exigences. Les estimations de la capacité de stockage du cerveau varient de 1010 à 1015 chiffres binaires. Je penche vers les valeurs les plus basses et crois qu’une très petite fraction seulement est utilisée pour les types supérieurs de pensée. La plus grande partie en est probablement utilisée pour la rétention des impressions visuelles. Je serais surpris que plus de 109 soient requis pour jouer de manière satisfaisante le jeu de l’imitation, du moins contre un homme aveugle. (Note — La capacité de l’Encyclopaedia Britannica, 11e édition, est de 2 × 109.) Une capacité de stockage de 107 serait une possibilité très praticable même avec les techniques présentes. Il n’est probablement pas nécessaire du tout d’accroître la vitesse des opérations des machines. Certaines parties des machines modernes qui peuvent être vues de manière analogue à des cellules nerveuses travaillent environ mille fois plus vite que ces dernières. Cela devrait fournir une « marge de sécurité » qui pourrait couvrir des pertes de vitesse survenant de bien des manières. Notre problème ensuite est de découvrir comment programmer ces machines pour jouer au jeu. Au rythme auquel je travaille actuellement je produis environ mille chiffres de programme par jour, de sorte qu’environ soixante travailleurs, travaillant régulièrement durant les cinquante prochaines années, pourraient accomplir le travail, si rien n’allait dans la corbeille à papier. Une méthode plus expéditive paraît désirable.

Dans le processus qui consiste à essayer d’imiter un esprit humain adulte nous sommes amenés à réfléchir longuement au processus qui l’a amené à l’état où il est. Nous pouvons remarquer trois composantes,

- L’état initial de l’esprit, disons à la naissance,

- L’éducation à laquelle il a été soumis,

- D’autre expérience, n’étant pas décrivable comme éducation, à laquelle il a été soumis.

Au lieu d’essayer de produire un programme qui simule l’esprit adulte, pourquoi ne pas plutôt essayer d’en produire un qui simule celui de l’enfant ? Si celui-ci était alors soumis à un parcours d’éducation approprié on obtiendrait le cerveau adulte. Présumément le cerveau-enfant est quelque chose comme un cahier tel qu’on l’achète chez le papetier. Fort peu de mécanisme, et beaucoup de pages blanches. (Mécanisme et écriture sont de notre point de vue presque synonymes.) Notre espoir est qu’il y ait si peu de mécanisme dans le cerveau-enfant pour que quelque chose de ce genre puisse être facilement programmé. La charge de travail en termes d’éducation peut, à première approximation, être considérée comme à peu près équivalente à celle requise pour un enfant humain.

Nous avons ainsi divisé notre problème en deux parties. Le programme-enfant et le processus d’éducation. Ces deux restent très étroitement liées. Nous ne pouvons pas nous attendre à découvrir une bonne machine-enfant dès la première tentative. Il faut expérimenter en enseignant à une telle machine et voir avec quel réussite elle apprend. On peut alors en essayer une autre et voir si elle est meilleure ou pire. Il y a un lien évident entre ce processus et l’évolution, par les identifications

Structure de la machine-enfant

Changements de la machine-enfant

Sélection naturelle

= Matériel héréditaire

= Mutations

= Jugement de l’expérimentateur

On peut espérer, toutefois, que ce processus sera plus expéditif que l’évolution. La survie du plus apte est une méthode lente pour mesurer les avantages. L’expérimentateur, par l’exercice de l’intelligence, devrait être capable d’en accélérer le cours. Tout aussi important est le fait qu’il n’est pas limité à des mutations aléatoires. S’il peut tracer la cause de quelque faiblesse il peut probablement penser au type de mutation qui l’améliorera.

Il ne sera pas possible d’appliquer exactement le même processus d’enseignement à la machine qu’à un enfant normal. Elle ne sera pas, par exemple, pourvue de jambes, de sorte qu’on ne pourrait pas lui demander de sortir remplir le seau à charbon. Il se peut qu’elle n’ait pas d’yeux. Mais même si ces déficiences pouvaient être surmontées par quelque ingénierie intelligente, on ne pourrait pas envoyer la créature à l’école sans que les autres enfants ne se moquent d’elle excessivement. Il faut lui donner un peu d’instruction. Nous devons ne pas trop nous inquiéter à propos des jambes, des yeux, etc. L’exemple de Mlle Helen Keller montre que l’éducation peut avoir lieu pourvu qu’une communication dans les deux sens entre maître et élève puisse avoir lieu par quelque moyen que ce soit.

Nous associons normalement punitions et récompenses au processus d’enseignement. Certaines machines-enfants simples peuvent être construites ou programmées sur ce genre de principe. La machine devait être construite de telle sorte que les événements ayant précédé de peu l’émission d’un signal de punition aient peu de chances de se répéter, tandis qu’un signal de récompense devrait augmenter la probabilité de répétition des événements qui lui ont conduit. Ces définitions ne présupposent aucun sentiment de la part de la machine. J’ai fait quelques expériences avec une telle machine-enfant, et réussi à lui enseigner quelques petites choses, mais la méthode d’enseignement était trop peu orthodoxe pour que l’expérience puisse être considérée comme réellement réussie.

L’usage de punitions et de récompenses ne peut au mieux être qu’une partie du processus d’enseignement. En gros, si le maître n’a pas d’autre moyen de communiquer avec l’élève, la quantité d’information qui peut lui parvenir n’excède pas le nombre total de récompenses et de punitions appliquées. D’ici à ce qu’un enfant ait appris à réciter « Casabianca » il se sentirait probablement fort endolori, si le texte ne pouvait être découvert que par une technique de « Vingt Questions », chaque « NON » prenant la forme d’un coup. Il est donc nécessaire d’avoir quelques autres canaux de communication « non émotionnels ». Si ceux-ci sont disponibles il est possible d’enseigner à une machine, par punitions et récompenses, à obéir à des ordres donnés dans quelque langage, e.g. un langage symbolique. Ces ordres doivent être transmis par les canaux « non émotionnels ». L’utilisation de ce langage diminuera grandement le nombre de punitions et de récompenses requis.

Les opinions peuvent varier quant au degré de complexité qui convient dans la machine-enfant. On pourrait essayer de la rendre aussi simple que possible en cohérence avec les principes généraux. Alternativement on pourrait avoir un système complet d’inférence logique « intégré ».3 Dans ce dernier cas la mémoire serait largement occupée par des définitions et des propositions. Les propositions auraient diverses sortes de statut, e.g. faits bien établis, conjectures, théorèmes mathématiquement prouvés, déclarations émanant d’une autorité, expressions ayant la forme logique d’une proposition mais sans valeur de croyance. Certaines propositions peuvent être décrites comme des « impératifs ». La machine devrait être construite de telle sorte que, dès qu’un impératif est classé comme « bien établi », l’action appropriée ait automatiquement lieu. Pour illustrer cela, supposons que le maître dise à la machine, « Fais tes devoirs maintenant ». Cela peut avoir pour effet que « Le maître dit : “Fais tes devoirs maintenant” » soit inclus parmi les faits bien établis. Un autre fait de cette sorte pourrait être « Tout ce que dit le maître est vrai ». En combinant ces deux faits on peut finalement conduire à ce que l’impératif, « Fais tes devoirs maintenant », soit inclus parmi les faits bien établis, et cela, par construction, signifiera que la machine se met effectivement à faire ses devoirs. L’effet est très satisfaisant. Les processus d’inférence utilisés par la machine n’ont pas besoin d’être tels qu’ils satisferaient les logiciens les plus exigeants. Il pourrait, par exemple, n’y avoir aucune hiérarchie de types. Mais cela ne signifie pas pour autant que des erreurs de type se produiront, pas plus que nous ne sommes forcés de tomber par-dessus des falaises sans clôture. Des impératifs convenables (exprimés à l’intérieur du système, ne faisant pas partie des règles du système) tels que « N’utilise pas une classe à moins qu’elle ne soit une sous-classe d’une classe mentionnée par le maître » peuvent avoir un effet similaire à « Ne va pas trop près du bord ».

Les impératifs auxquels peut obéir une machine qui n’a pas de membres sont forcément d’un caractère plutôt intellectuel, comme dans l’exemple donné ci-dessus (faire ses devoirs). Les plus importants parmi ces impératifs seront ceux qui régissent l’ordre dans lequel les règles du système logique concerné doivent être appliquées. Car pour chaque phase lorsqu’on utilise un système logique, il y a un très grand nombre d’étapes alternatives, dont n’importe laquelle est autorisée à être appliquée, pour autant qu’elle obéisse aux règles du système logique en question. Ces choix font la différence entre un esprit brillant ou médiocre, non la différence entre un raisonnement valable ou fallacieux. Des propositions conduisant à des impératifs de ce genre pourraient être « Lorsque Socrate est mentionné, utilise le syllogisme en Barbara » ou « Si une méthode a été prouvée plus rapide qu’une autre, n’utilise pas la plus lente ». Certaines de ces propositions peuvent être « données par autorité », mais d’autres peuvent être produites par la machine elle-même, e.g. par induction scientifique.

L’idée d’une machine apprenante pourrait apparaître paradoxale à certains lecteurs. Comment les règles d’opération de la machine peuvent-elles changer ? Elles devraient décrire complètement comment la machine réagira quel que soit son historique, quels que soient les changements qu’elle puisse subir. Les règles sont ainsi tout à fait invariantes dans le temps. Cela est tout à fait vrai. L’explication de ce paradoxe est que les règles qui sont changées dans le processus d’apprentissage sont d’une espèce un peu moins prétentieuse, ne revendiquant qu’une validité éphémère. Le lecteur peut faire le parallèle avec la Constitution des États-Unis.

Une caractéristique importante d’une machine apprenante est que son maître sera souvent très largement ignorant de ce qui se passe exactement à l’intérieur, bien qu’il puisse encore, dans une certaine mesure, prédire le comportement de son élève. Cela devrait s’appliquer très fortement à l’éducation avancée d’une machine issue d’une machine-enfant de conception (ou de programme) bien éprouvée. Cela contraste clairement avec la procédure normale lorsqu’on utilise une machine pour faire des calculs : notre but est alors d’avoir une image mentale claire de l’état de la machine à chaque moment du calcul. Ce but ne peut être atteint qu’avec un effort considérable. L’idée selon laquelle « la machine peut seulement faire ce que nous savons lui ordonner d’effectuer »4 paraît étrange devant cela. La plupart des programmes que nous pouvons mettre dans la machine auront pour résultat qu’elle fera quelque chose dont nous ne pouvons pas du tout faire sens, ou que nous regardons comme un comportement complètement aléatoire. Un comportement intelligent consisterait présumément en un écart par rapport au comportement complètement discipliné inhérent au calcul, mais un écart assez léger, qui ne donne pas lieu à un comportement aléatoire ni à des boucles répétitives inutiles. Un autre résultat important du fait de préparer notre machine à son rôle dans le jeu de l’imitation par un processus d’enseignement et d’apprentissage est que la « faillibilité humaine » est vraisemblablement omise d’une manière assez naturelle, i.e. sans « coaching » spécial. (Le lecteur devrait concilier cela avec le point de vue des pp. 24, 25.) Les processus qui sont appris ne produisent pas cent pour cent de certitude quant au résultat ; si tel était le cas ils ne pourraient pas être désappris.

Il est probablement sage d’inclure un élément aléatoire dans une machine apprenante (voir p. 438). Un élément aléatoire est plutôt utile lorsque nous cherchons une solution à quelque problème. Supposons par exemple que nous voulions trouver un nombre entre 50 et 200 qui soit égal au carré de la somme de ses chiffres, nous pourrions commencer à 51 puis essayer 52 et continuer jusqu’à ce que nous obtenions un nombre qui convienne. Alternativement nous pourrions choisir des nombres au hasard jusqu’à ce que nous en obtenions un bon. Cette méthode a l’avantage qu’il n’est pas nécessaire de garder la trace des valeurs qui ont été essayées, mais l’inconvénient qu’on peut essayer deux fois la même, bien que cela n’ait pas beaucoup d’importance s’il y a plusieurs solutions. La méthode systématique a l’inconvénient qu’il peut y avoir un énorme bloc sans aucune solution dans la région qui doit être investiguée d’abord. Or le processus d’apprentissage peut être regardé comme une recherche d’une forme de comportement qui satisfera le maître (ou quelque autre critère). Puisqu’il y a probablement un très grand nombre de solutions satisfaisantes la méthode aléatoire paraît meilleure que la méthode systématique. Il est à noter qu’elle est employée dans le processus analogue de l’évolution. Sauf qu’ici la méthode systématique n’est pas possible. Comment pourrait-on garder la trace des différentes combinaisons génétiques qui avaient été essayées, de façon à éviter de les essayer de nouveau ?

Nous pouvons espérer que les machines finiront par se mesurer aux hommes dans tous les domaines purement intellectuels. Mais par lesquels vaut-il mieux commencer ? Même cette décision est difficile. Beaucoup de gens pensent qu’une activité très abstraite, comme la pratique des échecs, serait la meilleure. On peut aussi soutenir qu’il vaut mieux pourvoir la machine des meilleurs organes sensoriels que l’argent puisse acheter, puis lui apprendre à comprendre et à parler anglais. Ce processus pourrait suivre l’enseignement normal d’un enfant. Des choses seraient montrées et nommées, etc. Là encore je ne sais pas quelle est la bonne réponse, mais je pense que les deux approches devraient être essayées.

Nous pouvons seulement voir à courte distance devant nous, mais nous pouvons y voir beaucoup de ce qui reste à faire.

BIBLIOGRAPHIE

- Samuel Butler, Erewhon, Londres, 1865. Chapitres 23, 24, 25, The Book of the Machines.

- Alonzo Church, « An Unsolvable Problem of Elementary Number Theory », American J. of Math., 58 (1936), 345–363.

- K. Gödel, « Über formal unentscheildbare Sätze der Principia Mathematica und verwandter Systeme, I », Monatshefle für Math. und Phys., (1931), 173–189.

- D. R. Hartree, Calculating Instruments and Machines, New York, 1949.

- S. C. Kleene, « General Recursive Functions of Natural Numbers », American J. of Math., 57 (1935), 153–173 et 219–244.

- G. Jefferson, « The Mind of Mechanical Man ». Lister Oration for 1949. British Medical Journal, vol. i (1949), 1105–1121.

- Countess of Lovelace, « Translator’s notes to an article on Babbage’s Analytical Engine », Scientific Memoirs (éd. R. Taylor), vol. 3 (1842), 691–731.

- Bertrand Russell, History of Western Philosophy, Londres, 1940.

- A. M. Turing, « On Computable Numbers, with an Application to the Entscheidungsproblem », Proc. London Math. Soc. (2), 42 (1937), 230–265.

- Il est possible que cette vue soit hérétique. Saint Thomas d’Aquin (Summa Theologica, cité par Bertrand Russell, p. 480) déclare que Dieu ne peut pas faire qu’un homme n’ait pas d’âme. Mais cela peut n’être pas une restriction réelle à Sa puissance, seulement un résultat du fait que les âmes des hommes sont immortelles, et donc indestructibles. ↩︎

- Les noms d’auteurs en italiques renvoient à la Bibliographie. ↩︎

- Ou plutôt « programmé dans », car notre machine-enfant sera programmée dans un calculateur numérique. Mais le système logique n’aura pas besoin d’être appris. ↩︎

- Comparer avec la déclaration de Lady Lovelace (p. 450), qui ne contient pas le mot « seulement ». ↩︎

🌐 Source

A. M. TURING, I.—COMPUTING MACHINERY AND INTELLIGENCE, Mind, Volume LIX, Issue 236, October 1950, Pages 433–460, https://doi.org/10.1093/mind/LIX.236.433