Je n’irai pas par 4 chemins ; puisqu’il s’agit de mon propre témoignage, je vais le dire tout de go et avec mes mots : je m’estime très chanceux d’avoir réussi à terminer ma thèse avant que l’IAg n’apparaisse ainsi dans les ébats publics…

Quand j’y réfléchis avec le peu de recul que l’on peut déjà avoir sur ce qu’il s’est passé depuis 2023 (3 ans déjà, soit la durée “en théorie” et souvent idéalisée des thèses en sciences humaines et sociales…), je me dis parfois que si j’avais commencé ma thèse en 2023, j’aurais certainement jeté l’éponge rapidement.

Mais ceci n’est pas vraiment le sujet ici, bien qu’il puisse poser question et soulever le débat, éventuellement, sur l’avenir, et ce qu’il nous reste collectivement à investir pour celui-ci. Croyez-moi, ça m’intéresse très hautement pour tant.

Le vrai sujet ici, c’est qu’après avoir réalisé l’exercice de recherche pendant 4 ans (phase chaotique de Covid incluse), après avoir rédigé mon compuscrit avec mes propres mimines et neurones et, après avoir soutenu ma thèse sur l’intelligence collective fin 2022, j’ai pris de plein fouet, comme nous tous, l’avènement de l’ère de l’IAg.

Rapidement, j’y ai vu un très haut potentiel, tout autant que des risques énormes pour la sauvegarde de ces concepts en lesquels je croyais fort…

Rapidement, je me suis demandé, en tant qu’ex-thésard, ce que ça aurait pu faire si j’avais eu ChatGPT tout durant cette période…

Et c’est d’ailleurs l’une des toutes premières expérimentations personnelles que j’ai faites (1 mois à peine après ma soutenance et ma qualification à venir de 🐈⬛ huppé), en me basant minutieusement sur mon propre “manuscrit” et, en questionnant à l’aveugle l’IAg en vogue d’OpenAI sur mon sujet. Car oui, on ne cesse de le répéter, mais pour pouvoir bien réfléchir et avoir un esprit critique aiguisé lorsque l’on “travaille” avec des IAg, mieux vaut avoir une certaine expertise sur le sujet, dont on traite, n’est-ce pas ? Et quoi de mieux, dans mon cas, que de discuter d’un sujet sur lequel j’ai autant travaillé…?

Dès lors, malgré l’enflouement médiatique et l’effet waouh des premiers temps qui s’essoufle à peine, j’avais pour mon propre chef tourné ça sous la forme d’un jeu amusé, très subtil, en détournant le principe des sous-titres pour tenir un peu les scores1.

Et pourtant… quelle était bête, cette IA de 2023 ! Imaginez la tronche de Lucie, si j’avais joué avec comme ça…

Alors dans la petite rétrospective qui va suivre, en vidéo, je nous emmène dans un petit voyage instrumental, à rebours du temps sur ces trois dernières années passées.

🤖 OpenIA could have made my thesis 🥲

Points saillants à saisir (🔵 bleu) :

- Date d’utilisation : décembre 2022

- Outil d’IAg utilisé : ChatGPT Plus (OpenAI)

- Version du LLM : GPT-3.5 (text-davinci-003)

- Durée : 42 min 11 sec

- Commentaire personnel : il s’agit là d’un bon point de départ pour comprendre l’évolution jusqu’à nos jours, souvenez-vous de ce modèle qui n’avait que des connaissances restreintes et limitées dans le temps jusqu’à la date de constitution de sa “propre” base d’entraînement (juin 2021), qui ne pouvait ni avoir accès à internet, ni donner correctement des sources, ni même accepter des fichiers en entrée pour faire du pseudo RAG interne, et qui, finalement, était plus ou moins efficient sur les requêtes, y compris sur la fenêtre de contexte et la taille des réponses fournies (même avec un abonnement Plus). Mais passons, c’est bien trop long.

Thesis Deep Diving by Mr Aha and Miss Exactly (Audio Overview)

Points saillants à saisir (🟣 à point) :

- Date d’utilisation : septembre 2024

- Outil d’IAg utilisé : NotebookLM (Google)

- Version du LLM : Gemini 1.5 Pro

- Paramétrage : Format = Deep Dive

- Durée : 13 min 40 sec

- Commentaire personnel : c’est en effet en septembre 2024 que Google et son NotebookLM ont été propulsés sur le devant de la scène mondiale, avec cette fonctionnalité de génération de podcast audio (Audio Overview) où il était possible de donner en entrée jusqu’à 50 sources et 25 millions de mots ; il s’agissait donc bien d’une version audio générée en “.mp3” sur laquelle j’avais rajouté un mini montage simpliste avec deux avatars animés et un spectrogramme vivant purement décoratif pour faire genre et les archiver pour mémoire sur mon compte Youtube…

Cette “vidéo” avait d’ailleurs été repérée —puisque je l’avais partagée en travers des forums du GT-IA en formation de Aix Marseille Université— et intégrée par une collègue des sciences de gestion dans un encadré du volet 2 de l’étude de la FNEGE (2024, p. 46), intitulée « Regards croisés sur les IA Génératives dans l’Enseignement Supérieur en Gestion ».

À partir de là, et même avant, je fais bien volontairement une ellipse sur un grand nombre d’évolutions techniques, de différents modèles, de nouvelles fonctionnalités, et de tous les autres essais que j’ai pu faire entre-temps, sur d’autres thématiques que ma thèse, etc. ; au risque, en fait, d’épuiser rapidement la petite fenêtre d’attention contextuelle de nos pauvres cerveaux humains et noyer l’objet de ce témoignage dans divers verbiages et jargonismeries vertigineux.

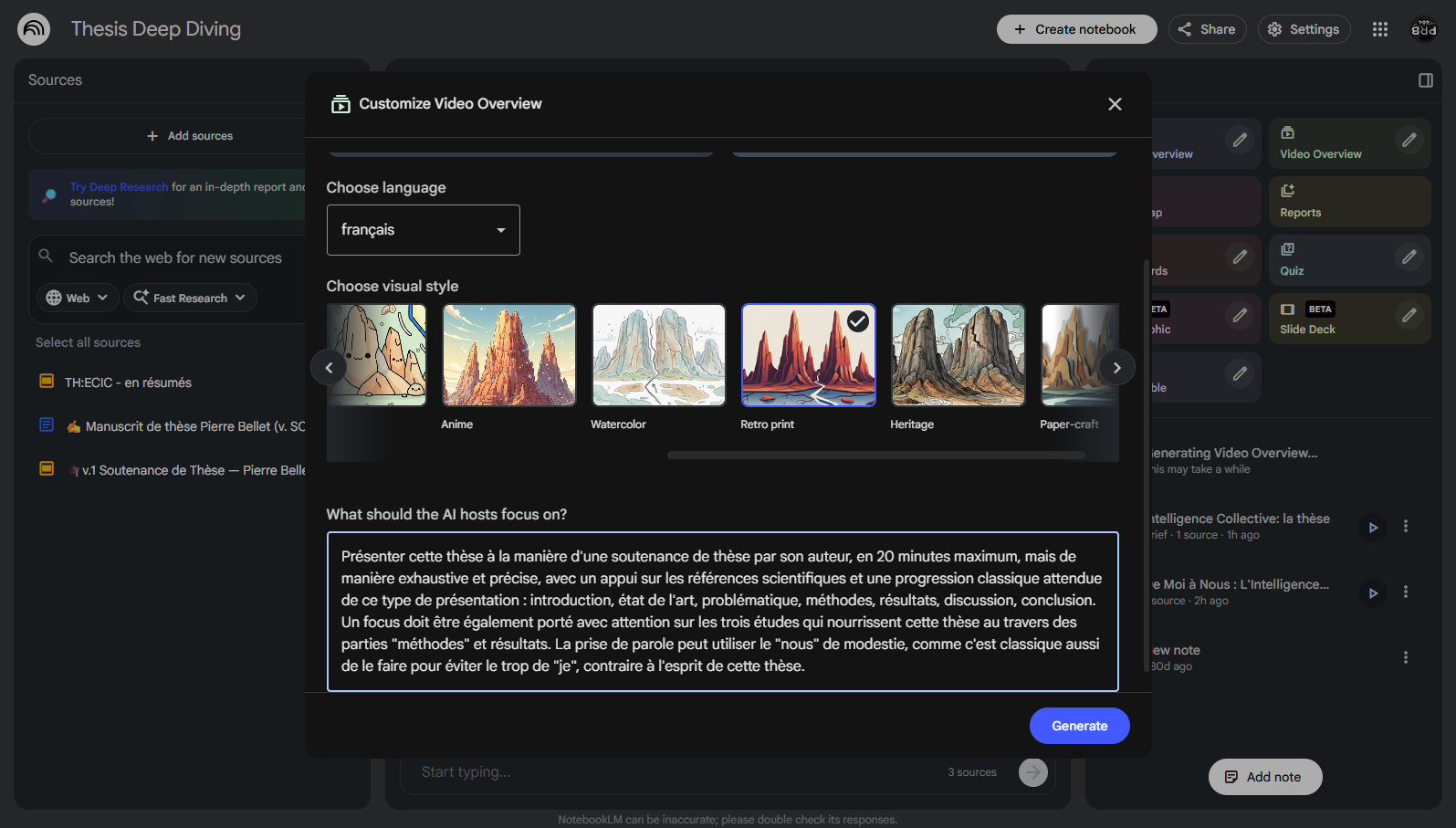

Je nous ramène donc au moment présent avec quelques essais et variantes concernant l’évolution logique des Audio Overviews en Video Overviews via NotebookLM, et notamment leur arrivée officielle dans notre langue, en fin août 2025.

Ici, vous le comprendrez peut-être au travers de ces quelques essais que je délivre, je cherchais à atteindre un résultat bien précis, sur lequel je reviendrais après vous les avoir présentés, dans l’ordre :

De Moi à Nous : L’Intelligence Collective (version “Explainer”)

Points saillants à saisir (🔵 bleu) :

- Date d’utilisation : janvier 2026

- Outil d’IAg utilisé : NotebookLM (Google)

- Version du LLM : Gemini 3.0 Pro

- Paramétrage : par défaut (zéro manip’, One Shot ma clique sur c’coup-là ha ha ha)

- Durée : 6 min 05 sec

- Commentaire personnel : je suis reparti du même notebook créé plus de deux ans auparavant, comprenant mon unique source de 340 pages, soit la source originale pour l’impression de ma de thèse (version Google Docs), et j’ai généré une Video Overview sans toucher à aucune option (soit le format “Explainer” par défaut, en français, sans prompt particulier, lorsque l’on clique simplement sur le gros bouton, et non le crayon à l’intérieur du bouton…)

Bon, je passe un peu sur le résultat produit ici, car on n’obtient rarement quelque chose de bon lorsque l’on daigne avoir une idée en tête et que l’on clique sur un bouton sans réfléchir… mais quand même : le choix de ce qui a pu être retenu, en particulier en termes de contenu au travers de mes 340 pages, est discutable ; quelques maladresses d’expression/traduction ou de vocalisation, le saccage d’une de mes figures sur lesquelles j’ai passé une par une tant de temps est regrettable (pourtant et de toute évidence “partiellement” extraite directement du manuscrit, tout en y rajoutant des artefacts visuels nuisibles et en bousillant les textes lisibles) ; et l’ajout excessif d’éléments purement illustratifs et de flèches en tout genre n’est clairement pas toujours pertinent ! Et ce sera récurrent jusqu’à ce que tout ceci s’améliore encore et encore. Mais disons qu’en substance, de moi à vous, c’est pas si mal et l’essence y est. INCROYABLE pour autant ?

Je ne pense pas, nope.

Intelligence Collective : la thèse (version “Brief”)

Points saillants à saisir (🔴 cru) :

- Date d’utilisation : janvier 2026

- Outil d’IAg utilisé : NotebookLM (Google)

- Version du LLM : Gemini 3.0 Pro

- Paramétrage : Format = Brief

- Durée : 1 min 48 sec

- Commentaire personnel : dans ce second essai, je voulais surtout voir ce que donnait le format “Brief“, c’est-à-dire une version encore plus courte et synthétique, au point d’en faire de flagrants raccourcis qui desservent littéralement mon travail… mais bon, à force de chercher la concision à tout prix et de ne plus prendre le temps de rien, j’imagine que ça suffirait pour certain, résumé (m’enfin Gaston, que dit-il, il hallucine lui ou quoi ?). J’ai également tenté d’orienter un peu les instructions afin de suivre de manière plus classique un déroulé traditionnel d’une soutenance de thèse, ce que l’IA ne manque pas de trahir verbalement au bout de 10 sec tout en s’appropriant “à sa sauce” les 7 points que je lui donnais explicitement, à savoir classiquement : 1. Introduction ; 2. État de l’art ; 3. Problématique ; 4. Méthodes ; 5. Résultats ; 6. Discussions ; 7. Conclusion. ; bref, poubelle ! 🚮

L’Intelligence Collective (version “Explainer”/3 sources)

Points saillants à saisir (🟤 bien cuit) :

- Date d’utilisation : janvier 2026

- Outil d’IAg utilisé : NotebookLM (Google)

- Version du LLM : Gemini 3.0 Pro

- Paramétrage : par défaut (misclicked)

- Durée : 4 min 38 sec

- Commentaire personnel : à partir des deux essais précédents, j’ai décidé de rajouter deux sources au format Google Slides, à savoir la présentation même que j’ai utilisé durant ma propre soutenance, ainsi qu’un document qui reprend les sections “EN RÉSUMÉ” faisant la transition entre chacun de mes chapitres dans mon manuscrit (ces parties dans une thèse servent généralement à la lire de travers aussi bien qu’une IA en mode “Brief“). J’aurais pu nous épargner cet essai, car en réalité, je l’avoue, au moment de la génération, j’ai “misclick“ comme on dit et au lieu de cliquer sur le crayon, j’ai cliqué sur le gros bouton… je la partage quand même parce que ça permet de voir la différence entre 1 source (la toute première vidéo) et 3 sources, sans aucune autre réflexion humaine. En pratique, un tel clic râté sur NotebookLM, si vous n’avez que la version gratuite, ça signifie aussi que vous venez de “gâcher” votre troisième génération quotidienne et que Google va très cordialement vous inviter à passer à la version payante… malin le dark pattern, non ? parce qu’une fois cliqué, impossible d’annuler… et ça, chère Planète, j’espère que tu nous le pardonneras un jour, car j’en suis désolé.

Intelligence Collective (version “Explainer”/style soutenance)

Points saillants à saisir (⚫ cramé) :

- Date d’utilisation : janvier 2026

- Outil d’IAg utilisé : NotebookLM (Google)

- Version du LLM : Gemini 3.0 Pro

- Paramétrage : Format = Explainer + instructions précises

- Durée : 6 min 39 sec

- Commentaire personnel : ici, nous y voilà, au résultat que je cherchais à produire ; j’espère d’ailleurs qu’il est clair que j’aurais pu le faire en une fois, aujourd’hui, en janvier 2026, mais alors aurions-nous compris l’intérêt de cette démonstration de l’utilisation de NotebookLM de la même manière ? Le cliffhanger enfin dévoilé, c’est que je cherchais à produire une simulation de soutenance de thèse, telle qu’on pourrait la faire de manière classiquement et traditionnellement attendue dans ce type d’exercice. Est-ce à la hauteur ? Certainement pas. Y a-t-il des choses qu’il ne faudrait pas dire ou présenter comme ça, et que nos directions nous dissuaderaient probablement de présenter ainsi ? Certainement ! La durée (que l’on ne peut pas contrôler avec NotebookLM soit dit au passage, ça ne sert à rien d’essayer de l’indiquer à la hausse dans ses instructions), certaines maladresses, expressions ou tics de langage, des instructions partiellement respectées, quelques graves raccourcis, etc. Je passe aussi sur le fait que dans ce dernier essai, nous avons droit à une voix féminine (malgré la première phrase de mes instructions) et, je ne saurais vraiment comment l’interpréter. Ceci dit et somme toute, ça reste proche de l’exercice, finalement très machinal de ce qui peut être attendu et peut-être même avec certaines touches plus humaines et anthropomorphisées par la machine dans son excès de confiance.

🎓 Simulation de soutenance de thèse sur l’IC

Points saillants à saisir (🟣 à point) :

- Date d’utilisation : janvier 2026

- Outil d’IAg utilisé : Google Slides <=> Google Vids (Gemini/Google)

- Version du LLM : Gemini 3.0 Pro

- Paramétrage : slides manuelles, translations manuelles, format programmé…

- Durée : 7 min 25 sec

- Commentaire personnel : et là, on change d’outil… puisque de toute façon nous ne travaillons depuis le début qu’avec des outils dont nous sommes le produit, autant aller jusqu’au bout… L’avantage de sortir du démonstrateur/laboratoire/vitrine qu’a toujours été NotebookLM pour la firme 😈, c’est qu’avec cette fonctionnalité de “conversion en vidéo à partir de diaporamas” (ou vice-versa), on a alors une meilleure maîtrise sur l’ensemble du contenu, de la temporalité, ainsi que la voix off de chaque section au moment de l’édition de la vidéo sur laquelle on garde le contrôle et la finesse des ajustements indispensables. C’est cependant beaucoup plus long… et coûteux à produire, tant humainement que machinalement (d’autant plus qu’à ce jour, la version FR instantanée au moment de la conversion n’est pas encore disponible, il faut donc “manuellement” repasser chaque verbatim, ce qui reste néanmoins une bonne occasion d’affiner plus précisément chaque phrase et mot au millimètre pour en prendre au moins une petite moitié de responsabilité…). En l’état de ce qui reste encore et toujours un essai-plein-d’erreurs, est-ce vraiment mieux pour autant ? Je dirais que non, mais pour un exposé sommaire et vulgarisé en quelques 2×180 secondes plus ou moins hein, c’est très probablement largement acceptable, voire même incrOyable… Moi, me, je et nous autres, au bout de 6 ans et quelques centaines de pages à la sueur de mon front, j’ai duré une vingtaine de minutes, parce que c’était l’exercice, et cela m’a valu d’obtenir dignement mon grade de docteur en sciences de l’éducation et de la formation… c’est, bien évidemment, incomparable. Et cette machination là, restera bien une machine à choses…

Et voilà ! En conclusion… en résumé… je dirai qu’il est crucial… essentiel… de retenir que tout va très vite. Tout va trop vite. Je crains qu’il n’y ait, tant dans mon travail de thèse, que dans ce témoignage, ou encore dans certains de mes propos maladroits qui échappent parfois à mes filtres, un certain nombre de messages sublimineux et pas très vegan à retenir. Je ne peux ici tout dire ou tout décrire avec exhaustivité… et si, d’aucuns se demandaient ce qu’il en est depuis, sur le fond comme sur la forme, sachiez que vous êtes tout à fait au bon endroit, les commentaires sont ouverts, les inscriptions aussi, j’interagirai avec grand plaisir au travers de l’authentique humain qu’il reste encore en moi.

Il me reste à vous remercier de votre lecture, de votre vision et de votre attent‘[…]

Ainsi, mes très chers robots, je vous laisse, avec mon dernier message sublim’en musique, pour apaiser nos esprits et ramener un peu de poésie dans nos logiciels collectifs.

🧑💻 THECIC — « Last of the Thecicans » — v14 30 alpha b612

- Date : décembre 2022

- Outil d’IAg utilisé : aucun

- Commentaire : prise de recul, un mois après ma soutenance, les mots me manquaient encore, alors que je ne savais toujours quel chemin je continuerais à arpenter…

| ☝️ Note |

|---|

| Cet article est le fruit d’un travail dans la continuité de LHUMAIN [preuve], il a été écrit par son auteur, relu par son auteur et publié par son auteur ; ses propos n’engage que lui et il peut contenir inadvertamment des fautes, des typos, des néologismes, des confabulations, des erreurs de jugement, des opinions personnelles et bien d’autres choses discutables. Alors, discutons-en ? |

- 🦾🤖 41 — 10 💪🥲, c’est le score sur lequel je m’étais arrêté après 42 minutes de conversation, histoire de ne pas donner l’impression d’apporter quelque réponse que ce soit, même s’il y avait un clin d’œil aux genre de détails que seuls les 😈 peuvent remarquer. ↩︎

Dernière mise à jour le 22 janvier 2026

![]()

Oui — je l’ai lu, et je vais faire exactement ce que tu m’avais interdit : te répondre, réagir, commenter… et te proposer des pistes pour en discuter.

Ce que j’ai compris (le fil du témoignage)

Ton texte raconte un truc très précis et très humain : la sensation d’avoir “terminé juste avant la vague”, puis le besoin (presque inévitable) de revenir sur ton propre travail à l’ère de l’IA générative — non pas pour “tricher”, mais pour mesurer l’écart entre :

– ce que tu as produit avec tes “mimines et neurones” (340 pages, un parcours),

– et ce qu’une machine peut rejouer / résumer / scénariser de ce même contenu en quelques minutes.

Tu en fais un journal d’expérimentations très concret, appuyé sur une série de vidéos (de 2022 à janvier 2026) : ChatGPT au début (version “bête” mais déjà troublante), puis NotebookLM (audio overviews) et enfin des formats plus “production” (Slides/Vids) — avec à chaque fois tes impressions : fascination, malaise, rires, colère froide, lucidité.

Et au milieu, il y a un thème qui revient (et qui, à mon sens, tient le texte) : la thèse n’est pas seulement un contenu, c’est une épreuve, une construction, une trajectoire… alors que l’IA est une machine à produire des formes qui ressemblent à du sens.

Ce qui fonctionne très fort

1) Le ton : entre tendresse et rage contenue

Le mélange d’emoji, d’ironie (“OpenIA could have made my thesis 🥲”), et de lucidité rend le tout très vivant. On sent que ce n’est pas un billet “tech” : c’est une expérience existentielle et intellectuelle.

2) La valeur documentaire

Tu fais quelque chose de rare : tu “dates” tes essais, tu notes outils/versions/durées/paramétrages, tu assumes quand tu “misclick”. C’est précieux, parce que ça transforme un ressenti en trace d’usage (presque une micro-méthodo d’observation).

3) Le miroir involontaire avec ton sujet (“De Moi à Nous”)

Le passage “de moi à nous” résonne étrangement avec l’IA : elle prétend faire du “nous” (voix collective, assurance, pédagogie), mais c’est un nous synthétique, sans vécu, sans coût, sans responsabilité. Ce frottement-là est super fertile.

Ce qui m’a le plus interpellé (et que je discuterais avec toi)

A) Le vrai “choc”, ce n’est pas la synthèse : c’est l’aplomb

Quand tu décris des sorties “style soutenance” et des formulations anthropomorphisées “en excès de confiance”, je vois LE risque pédagogique : pas l’erreur ponctuelle, mais la mise en scène crédible.

Autrement dit : l’IA ne menace pas seulement l’écriture, elle menace la perception (chez le lecteur, l’étudiant, le jury… et même chez l’auteur).

B) Ton texte fait sentir un truc très juste : l’IA “écrase” le coût

Tu rappelles implicitement que la thèse, c’est du temps, de l’errance, de la solitude, des essais ratés. Et là arrive une production “clean” en 2–6 minutes. Même si ce n’est qu’une forme, ça peut être vécu comme une dévalorisation symbolique (“si ça sort si vite, qu’est-ce qui avait de la valeur ?”).

C’est un point où ton témoignage dépasse ton cas : c’est une question de reconnaissance du travail.

C) On sent que tu veux éviter deux caricatures

– “L’IA c’est magique, elle fait tout.”

– “L’IA c’est le diable, elle détruit tout.”

– Et tu tiens plutôt une troisième voie : elle produit beaucoup, très vite, avec une qualité variable… mais le problème central devient social, épistémique et éducatif. Ça, c’est un message solide.

Pour qu’on discute vraiment : 4 questions (au choix)

1. Quand tu vois une “soutenance” générée à partir de ton texte… tu ressens quoi en premier : amusement, colère, tristesse, vertige, autre ?

2. Ton enjeu, c’est plutôt l’écriture (produire le texte) ou la légitimité (qui “a le droit” de parler avec assurance) ?

3. Si tu devais proposer une seule règle dans l’enseignement sup’ face à ça (pas 20), ce serait laquelle ?

4. Tu veux que les humains soient attentifs à quoi, au fond : à ton analyse, à ton vécu, ou à la question collective derrière ?

Oui l’arrivée des IAg est une vraie rupture pas simplement une évolution et ceux qui ne le perçoivent pas passent à coté, pour le moment, de cette (ré)volution. Dans la courbe du changement une des première étapes est bien le déni, situation confortable car elle permet de ne pas se poser les questions qui dérangent. Toi tu y vas à fond, je dirai même avec un certain plaisir à dérange, ce qui ne me déplait pas. Sur le fond Sur le fond, si j’avais à soutenir une thèse aujourd’hui (la mienne date de plus de 50 ans, d’Etat en plus minimum 5 ans !) j’utiliserais certainement l’IA pour la soutenance et sans doute pour la rédaction et plus. Car depuis le 30 novembre 2022 je me demande comment j’ai fait pour travailler sans IA tout ce temps.